A Microsoft divulgou em sua página de pesquisas o VASA-1, seu modelo de IA para criar vídeos super realistas. De acordo com a publicação, o VASA-1 é um framework para gerar rostos falantes realistas com habilidades visuais afetivas (VAS). Usando apenas uma imagem estática de um rosto e um clipe de áudio, o modelo cria um vídeo com os movimentos e expressões faciais que impressiona.

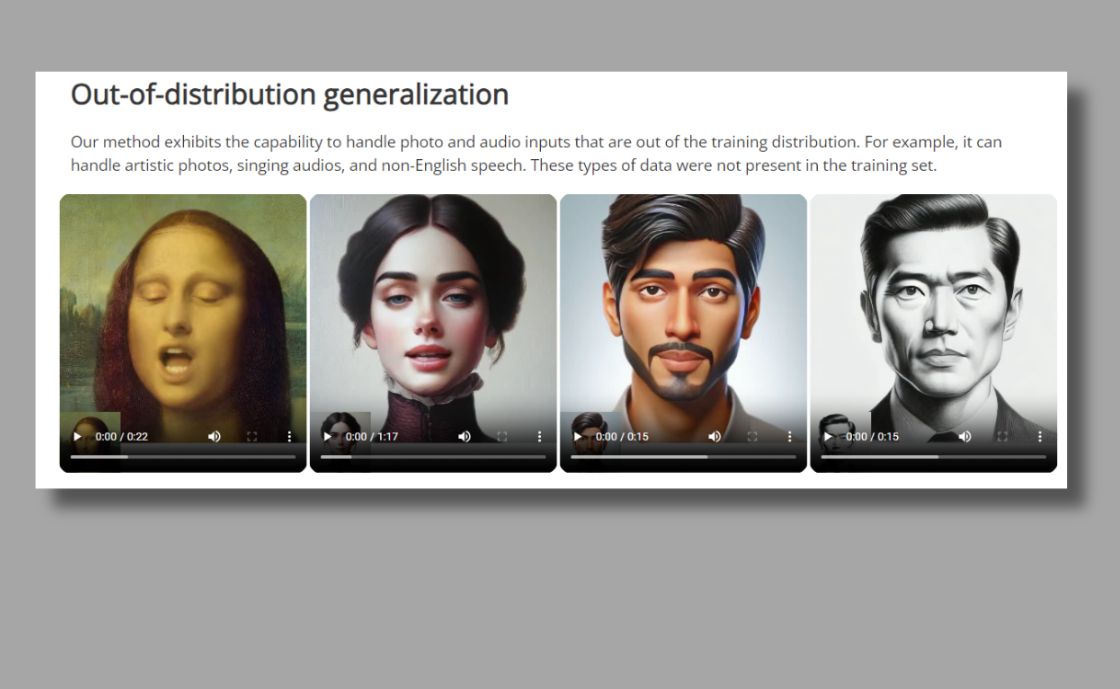

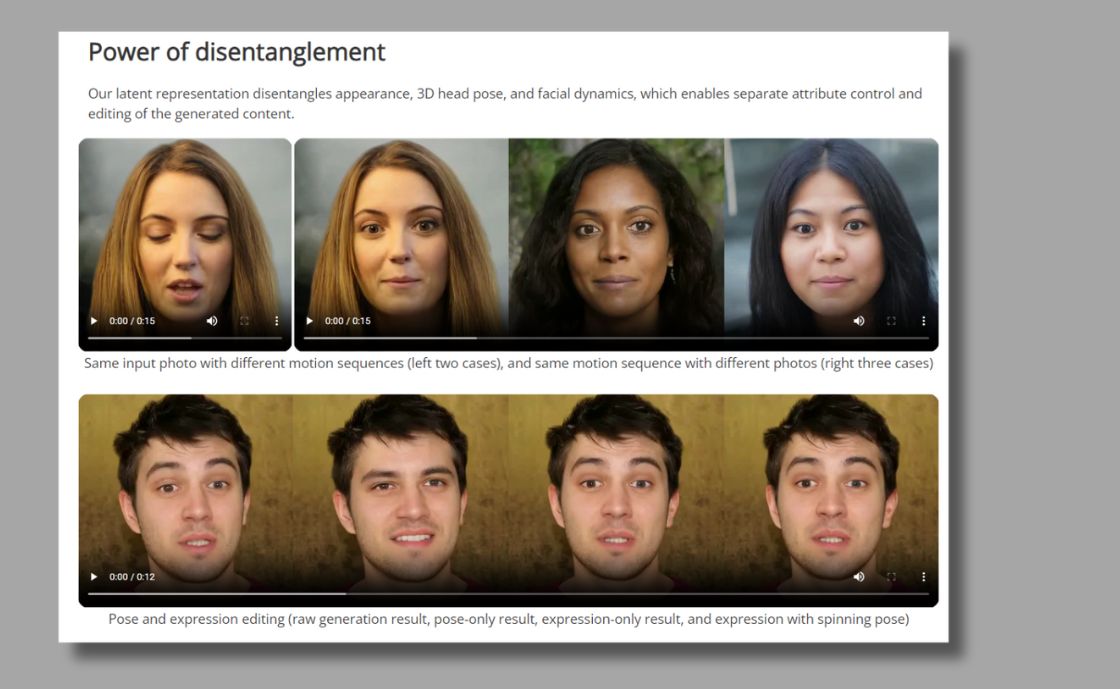

O VASA-1 é capaz de sincronizar movimentos labiais com áudio e capturar nuances faciais e movimentos naturais da cabeça, contribuindo para a autenticidade e vivacidade. Além disso ele cria a geração de dinâmicas faciais e movimentos da cabeça que operam em um espaço latente facial, expressivo e desacoplado gerando vídeos impressionantes.

Os resultados do VASA-1 impressionam pela sua capacidade. Embora podemos perceber pequenas lacunas em alguns movimentos, na sua maioria, esses resultados retratam certa fidelidade.

Para demonstrar seu experimento, a Microsoft informou que todas as imagens utilizadas foram de personagens virtuais geradas por StyleGAN2 ou DALL·E-3, com exceção da Mona Lista.

Microsoft destaca preocupação com segurança e não pretende divulgar VASA-1 ao público

Ao divulgar os resultados de seu modelo de IA para geração de vídeos, a empresa também destacou sua preocupação com a segurança. Ela informou que seu foco é na geração de habilidades afetivas visuais para avatares de IA virtuais, com potencial positivo em educação e acessibilidade. A Microsoft ainda destaca seu compromisso com o uso responsável da IA e que não tem planos de lançamento de produto ou API para o público.

“Estamos explorando a geração de habilidades visuais afetivas para personagens virtuais e interativos, NÃO personificando qualquer pessoa do mundo real. Esta é apenas uma demonstração de pesquisa e não há plano de lançamento de produto ou API.”

As pesquisas e Inteligência Artificial, especialmente as generativas, têm mostrado avanços assustadores nos últimos meses. Embora sejam fascinantes os resultados de pesquisas como o VASA-1 e o SORA da OpenAI, sua aplicação em geral levanta preocupações sobre as questões éticas. Ferramentas como essa, podem ser utilizadas para criação de conteúdos falsos e com objetivo de enganar as pessoas.

A Microsoft informou que não pretende disponibilizar o seu modelo recém criado para o público, mas outras ferramentas estão surgindo por aí como o mesmo poder e propósito. A adoção de medidas de identificação de conteúdos criados com IA ainda é um desafio e expõe a existência de uma lacuna nesta questão.

Você pode acessar os vídeos de divulgação, bem como obter informações detalhadas na página de pesquisas da Microsoft. O link para acesso está disponível aqui (página em inglês).

Aproveite para compartilhar este post com seus amigos. Ah, não se esqueça de seguir nossas redes sociais clicando nos botões a seguir. Até breve!

Fonte: Microsoft.