A OpenAI anunciou que está tomando algumas medidas para ajudar na detecção de conteúdos gerados por seus modelos de IA. De acordo com anúncio, a criadora do ChatGPT está trabalhando em uma ferramenta que, até então, ela chama de “classificador”. O objetivo dessa ferramenta é detectar quando uma imagem foi gerada através de seu modelo de IA, o DALL-E.

A empresa fez o anúncio em seu blog, onde também comunicou a abertura de inscrições para acesso a esse classificador para o primeiro grupo de testadores. Esse grupo inclui laboratórios e organizações sem fins lucrativos de jornalismo voltados para pesquisa. A empresa explica que o objetivo inicial é permitir a avaliação da eficácia desse classificador, através de pesquisas independentes. Além disso, a empresa espera feedbacks de sua aplicação no mundo real, além de outras informações relevantes.

Desempenho do detector de imagens da OpenAI

A OpenAI publicou que em testes internos o seu classificador apresentou alta precisão ao diferenciar imagens não geradas por IA daquelas geradas pelo DALL-E 3. Ela detalhou que a ferramenta “não dispara” para imagens geradas sem IA, e chegou a uma variação de 98% de acerto das imagens geradas usando seu modelo de Inteligência Artificial. Por outro lado, a variação chegou a menos de 5% para imagens geradas sem o uso de IA e detectadas incorretamente.

Além disso, a empresa informou que seu classificador consegue lidar com alterações comuns nas imagens, como compactação, corte e ajustes de saturação. Embora pequenos ajustes como esses causaram pequeno impacto no seu desempenho, outras modificações podem reduzir sua eficácia, informa a empresa. Por outro lado, a empresa informou que seu classificador tem desempenho inferior ao distinguir imagens geradas por outros modelos de IA, chegando a uma variação de 5-10% da detecção de imagens geradas por outros modelos.

Outras medidas estão sendo tomadas

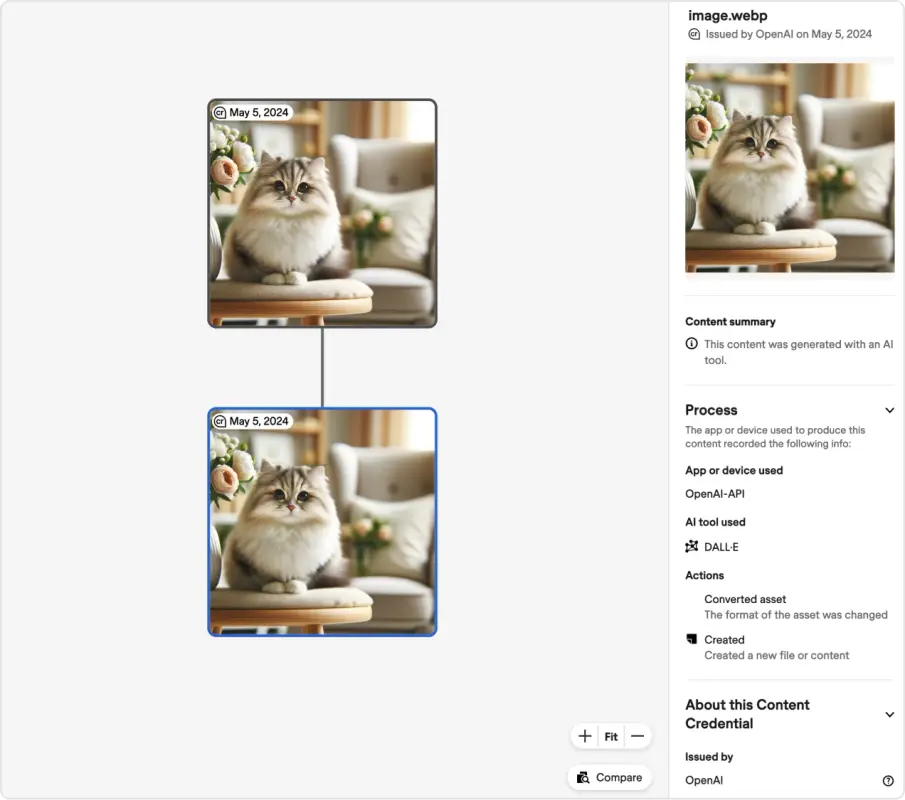

Além do classificador, a OpenAI informou que está tomando outras medidas para identificar conteúdos gerados por modelos de IA. Em sua postagem, a empresa anunciou que está se juntando ao Comitê Diretor da C2PA – Coalition for Content Provenance and Authenticity (Coalizão para Proveniência e Autenticidade de Conteúdo no termo em inglês). Trata-se de uma organização sem fins lucrativos, um consórcio apoiado por várias companhias para desenvolver especificações técnicas para procedência de autenticidade de conteúdos. Conforme divulgado, desde o início deste ano a empresa vem adicionando metadados C2PA nas imagens geradas por seus modelos de IA, incluindo DALL-E 3, ChatGPT e na API OpenAI.

Outra medida implementada pela empresa é a adoção de marca d’água de áudio no Voice Engine, seu modelo de voz personalizado. Essa ferramenta ainda se encontra em uma prévia de pesquisa limitada, informou a empresa. Assim, os conteúdos de áudio terão um sinal imperceptível e de difícil remoção, tornando um mecanismo de identificação desse conteúdo.

O anúncio da empresa criadora do ChatGPT mostra sua preocupação e os desafios enfrentados ao promover para as pessoas a possibilidade identificar a origem do conteúdo digital. Tais medidas são importantes na tentativa de combater a desinformação criada por conteúdo enganoso. No início deste ano a Meta anunciou a rotulagem de imagens geradas por IA em postagens com o mesmo propósito.

Compartilhe com seus amigos para que eles também desbravem o vasto mundo da tecnologia. Ah, não se esqueça de seguir nossas redes sociais nos botões a seguir. Até breve!